幾年前談到自動駕駛,廠家卷的還是芯片算力和激光雷達數量,但如今消費者已經意識到,硬件的豐儉與實際的智駕能力并不成正比,很多時候都是割韭菜的噱頭。最典型的例子是放言“4顆(激光雷達)以下別說話”的機甲龍,以及搭載4顆英偉達Orin芯片,總算力達到1016 TOPS的蔚來ET7,前者胎死腹中,后者寂寂無名。

從去年開始,業界迅速從卷硬件過渡到卷軟件。相比看得見摸得著的芯片和激光雷達,軟件的宣傳話術更加晦澀抽象,讓外行不明覺厲。筆者建議,下面這4個出現率極高的專業術語,你有必要了解一下,能幫你從“韭菜”變專家。

1、端到端——高階智駕的底子

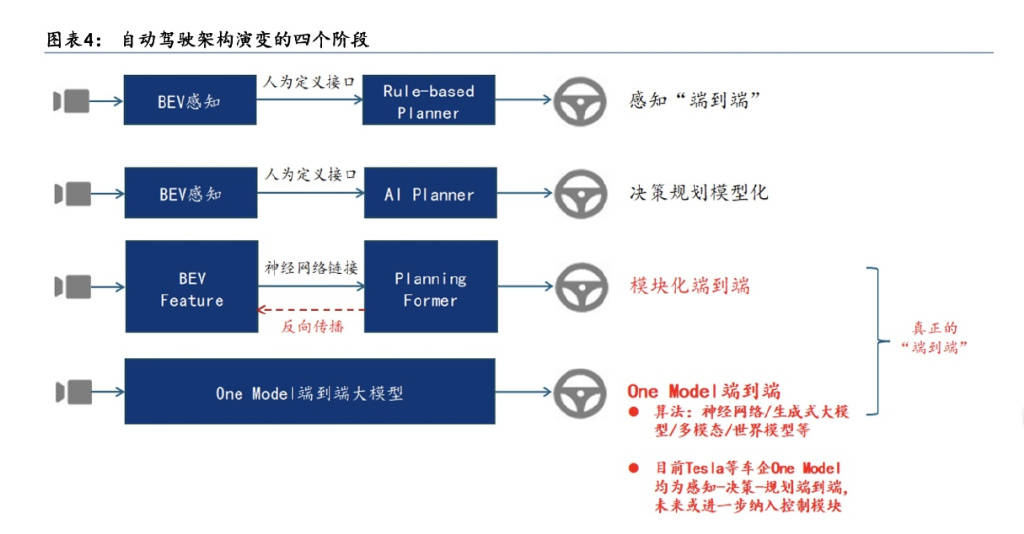

端到端(E2E)這一自動駕駛的算法范式,由特斯拉率先跑通,后續大批企業跟進,成為業內公認的發展方向。

簡單來說,端到端自動駕駛算法模擬人腦神經元連接,在模型的一端輸入感知信息,另一端直接輸出軌跡或者控制信號,實現了對駕駛行為的“融會貫通”。相比傳統模塊化流水線式的架構,端到端能夠使信息無損傳遞,減少人為偏見,大幅提升智駕的能力上限;同時,機器可以從“行為”學習“行為”,讓駕駛變得更加絲滑和擬人化。

在廠家的描述中,端到端就是打通自動駕駛的“金鑰匙”。但事實上,向高階發展的技術路徑仍沒有完全收斂,它存在著“先天缺陷”,自身可解釋性和驗證性較差。如同人腦,會短路,會出現幻覺,你卻很難說清到底哪里出了問題。

長安汽車首席智能駕駛技術官陶吉認為,“端到端的學習肯定是通往終極自動駕駛的必要一步,但肯定不是充分的一步”。

隨著自動駕駛技術的快速發展,端到端算法模型的入門門檻大幅降低。小馬智行CTO樓天城直言,現階段,訓練出一個一般性能的端到端模型不是問題,挖點人,基于公開的駕駛數據,大差不差都能搞出來。這也是為什么一夜之間,各家車企都拿出了自研的端到端智駕系統。

但有一點需要明確,端到端本身屬于架構層面的概念,與模仿學習、強化學習、LLM、VLA等技術手段/方法并不是同一層面的概念。類似于汽車的電子電氣架構從分布式升級到域集中式,再到中央計算架構的過程,在每一個特定的架構階段,各廠商可以采用不同的算法和硬件來實現。因此,即使是在相同的電子電氣架構模式下,也會有表現差異巨大的系統。所以千萬不要迷信“端到端”。

2、D2D——衡量端到端性能的關鍵功能

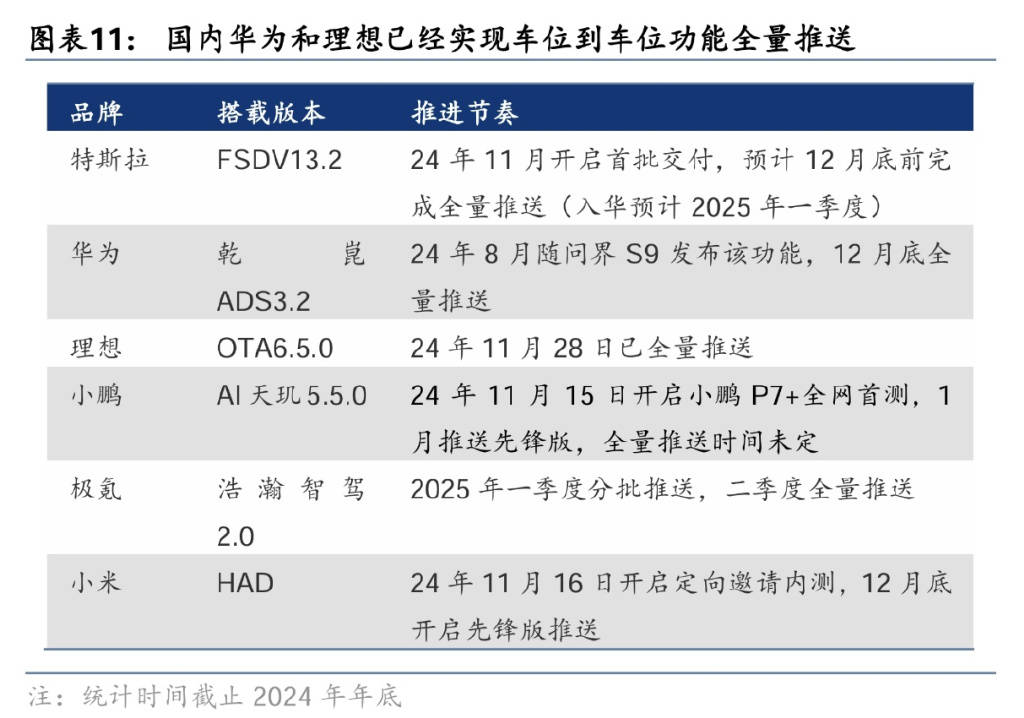

D2D即Door to Door,意為從出發車位泊出到目的地車位泊入,車輛可實現全程無接管的點到點全場景自動駕駛。

2025年高階智駕進入快速普及期,市場競爭邏輯已經從“人無我有”升級為“人有我優”。如今各家都在強調智駕的體驗和好用度,在之前“全國都能開”的基礎上,追求實現“車位到車位、門到門”等全場景的智能駕駛體驗。

D2D正在成為衡量端到端性能的關鍵指標之一,借助該功能,車企能夠向用戶展示智駕系統在全場景下的連貫性與完整性,以及其實際應用的價值。目前,包括華為、理想、小米、極氪等多個企業,已經開始分批推送D2D功能。

不過,業界對這一功能的理解和實現方式不盡相同。一種以理想為代表,采用的是“VPA(記憶泊車/代客泊車)+NOA(智駕領航)+VPA”的技術路徑,即在停車場路段,驅動系統行駛的是記憶泊車/代客泊車模式,駛入公開道路后,則立刻轉變為智駕領航模式。其強項是可自主通行ETC,且不限范圍、無需學習,全國超1萬個收費站均可識別通行。

而特斯拉、小鵬這一派則用一套模式打通全場景,即無論是在園區封閉路段、地下停車場區域還是在公開路段,顯示界面一直保持智駕NOA畫面,不會隨場景變化切換軟件系統。它們更注重智駕應對復雜路況的連貫性與完整性,其車輛能夠在整個“車位到車位”過程中,應對復雜路口、匯流變道、識別并避讓特種車輛,實現U型掉頭等特殊操作,做到全程無接管。

無論選擇哪種路徑,實現D2D都意味著智駕能力要接近L3級水平,這對算法、算力和數據提出了巨大挑戰。從2024年開始,端到端+VLM雙架構成為業界新寵,被視為L3的主要解決方案。

3、VLM——端到端1.0的外掛

VLM即視覺語言模型,相當于LLM(大語言模型)的進階版,可將視覺信息(如圖片、視頻)和自然語言文本聯系起來,此前在具身智能領域已有較多探索。

在自動駕駛領域,VLM能夠識別道路環境、交通標志、行人、車輛等,并通過大量訓練理解交通場景中的復雜交互事件,為自動駕駛系統提供決策支持。

VLM的引入使得自動駕駛系統的決策更加擬人化,能夠根據當前環境做出合理的駕駛決策,從而提高系統的安全性和可靠性。

在國內,理想是第一家公開將VLM概念引入自動駕駛的車企。它在車端芯片上部署了雙系統方案。系統1(端到端模型)完全靠自己的視覺感知,執行操作。系統2(VLM)能夠提供復雜環境的理解能力、讀懂導航地圖的能力以及交通規則的理解能力,輔助系統1進行規劃決策。系統1可以解決智能駕駛過程中95%的場景,剩下5%的情況就要交由系統2來進行理解和判斷。

這就相當于VLM是端到端的外掛,或副駕教練的角色。目前,吉利汽車的“千里浩瀚”智駕系統,以及小米智駕系統HAD采用了端到端+VLM架構。

但也有企業認為,VLM占用的算力和所實現的功能之間的投入產出比不夠高,“兩個模型,資源占用方面不是最高效的方式,會降低模型效果,只不過現在的數據還不能支撐一個模型訓練好。這是一個過渡階段,將來還是會融合。”

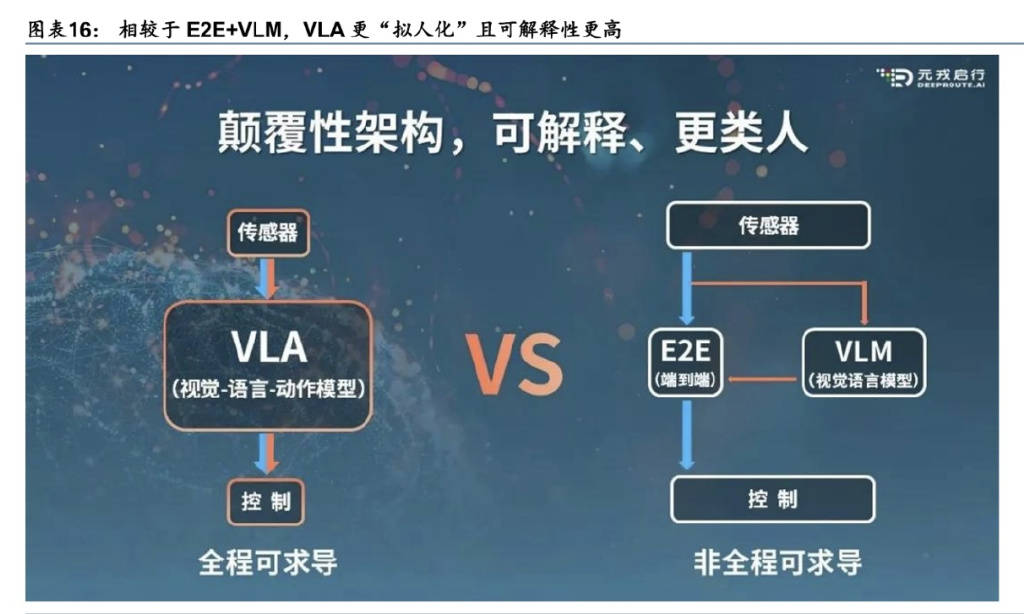

“特斯拉的路徑已經證明了,好的司機是不需要教練的。”在一些業內人士的眼中,VLM是端到端1.0的一次技術優化,而真正的2.0換代升級是VLA。

4、VLA——端到端技術換代

VLA(視覺-語言-動作模型)最早由Google DeepMind提出,是在VLM的基礎上發展而來的,被視為端到端大模型2.0——多模態機器學習模型。在自動駕駛領域,VLA模型可以從傳感器數據中提取豐富的環境信息,借助語言模型理解人類指令并生成可解釋的決策過程,最后將多模態信息轉化為具體的駕駛操作指令。

與傳統的視覺語言模型(VLM)相比,VLA 的優勢在于其不僅可以解析圖像和文本信息,還能實現類人推理與全局理解。

據元戎啟行CEO周光介紹,在面對復雜的交通規則、潮汐車道、長時序推理等特殊場景時,VLA模型能夠比以往的系統更好地理解和應對。例如,在推理時長方面,傳統的基于規則(rule-based)方案只能推理1秒鐘的路況信息并做出決策控制;端到端1.0階段的系統能夠推理未來7秒的路況,而VLA模型則能夠對幾十秒的路況進行推理,顯著提升了自動駕駛系統的決策能力和適應性。

此外,VLA系統透明,能通過車內大屏向用戶解釋“為什么這么開”,從而增強用戶對自動駕駛系統的信任感。

有行業人士表示,VLA模型對智駕的演進意義重大,讓端到端理解世界的能力更強后,“長遠來看,在L2輔助駕駛到L4自動駕駛的飛躍中,VLA可能會成為關鍵跳板”。

目前在國內,理想已開始研發下一代VLA智駕大模型,目標在今年下半年實現項目落地。吉利汽車和元戎啟行也在積極推動VLA,各家都在比拼落地時間。

但短期內,VLA上車還面臨兩大難點。一是車端算力不足,理想車端雙Orin-X芯片運行端到端+VLM算力已經比較吃緊。而VLA的模型結構更復雜,參數也會進一步擴大,對硬件算力和數據閉環的迭代能力要求就更高。

以元戎啟行的VLA模型RT-2為例,其參數量高達50億以上,而理想汽車的VLM模型參數量為22億,不到RT-2的一半。因此業內普遍認為,部署VLA模型對芯片算力的要求要提升到英偉達DRIVE Thor級別(單顆算力為2000TOPS)。

未來具備更強芯片整合能力和垂直整合能力的企業,有望在VLA技術的競爭中占據先發優勢。目前行業頭部競爭者如特斯拉、華為、蔚小理、Momenta等都在逐漸走向軟硬一體,針對自研模型定制化開發更匹配的智駕芯片,可以做到最大程度的優化。

另一大挑戰是如何將端到端與多模態大模型的數據與信息作深度交融。這考驗著智駕團隊的模型框架定義能力、模型快速迭代能力。

地平線副總裁兼首席架構師蘇箐曾對筆者表示,特斯拉目前在智駕領域依舊“遙遙領先”,其最強之處在于工程化能力——不僅要持續創新,快速將前沿理論轉化為可量產的技術和產品,還要注重效率和成本。

可以肯定的是,2025年開始大規模普及的高階智駕,將帶動新一輪市場洗牌,價格向下,體驗向上成為各家比拼的關鍵詞。而這背后,是對企業的深刻變革,和對競爭規則的重新定義。

端到端架構打破了傳統模塊化開發模式,車企需加強跨部門協作,并且強調AI領軍人才,提升AI主導的智能駕駛研發能力。同時,工程化能力成為核心競爭力,除了研發投入與人才儲備,端到端落地速度/智駕迭代頻率/數據閉環能力等,可以幫助我們觀察車企的工程化能力。

雖然市場看似一夜之間“普及”了端到端,但實際上,強弱之間的差距會越來越大,VLA的研發需要大量資源投入,只有少數頭部大廠才能支撐全棧自研,技術和數據的雙重優勢將進一步鞏固它們的市場地位,中小玩家難以望其項背,最終不論營銷如何包裝,都要依靠供應商補齊智駕短板。